我的 200 美元 AI 订阅方案

写在前面

AI Coding 交流群中最老生常谈的一个问题便是,大家都是订阅的什么工具,这个问题太频繁了,以至于我觉得有必要写一篇文章,如果愿意拿出 200 美元左右订阅 AI 工具,这笔钱到底该怎么花?

这事儿放在半年前,我可能会说:挑一个顺手的工具,买些额度就行。但现在我的答案变了。

AI 编程工具和通用 AI 产品在过去半年迭代得太快,已经不是简单的”买 Token”问题。尤其是 200 美元这个预算,对大多数个人开发者来说并不便宜,所以它必须同时回答两个问题:第一,能不能实实在在提升我的生产力;第二,能不能帮我建立对 AI 工具和工作流的判断力。

我觉得订阅几款头部产品至少有四层价值。

第一,是直接提升生产力。 这不是一个虚的理由。一个靠谱的 AI 编程工具,确实能帮你更快读懂陌生代码库、更稳地改跨文件需求、更省力地写测试、补文档、做调研。只要你每周有几次真实开发任务能被它加速,订阅费就不只是”尝鲜成本”,而是实打实的工具投入。

第二,是认知层面的更新。 AI 编程工具的变化速度非常夸张,每家的产品设计、Agent 架构、上下文管理方式都不一样。光看博客、发布会和评测,拿到的是二手信息;亲手用一个月,得到的是肌肉记忆。这种”知道”和”用过”的差距,在你和团队讨论方案、和客户聊产品、判断技术趋势时会立刻显现出来。

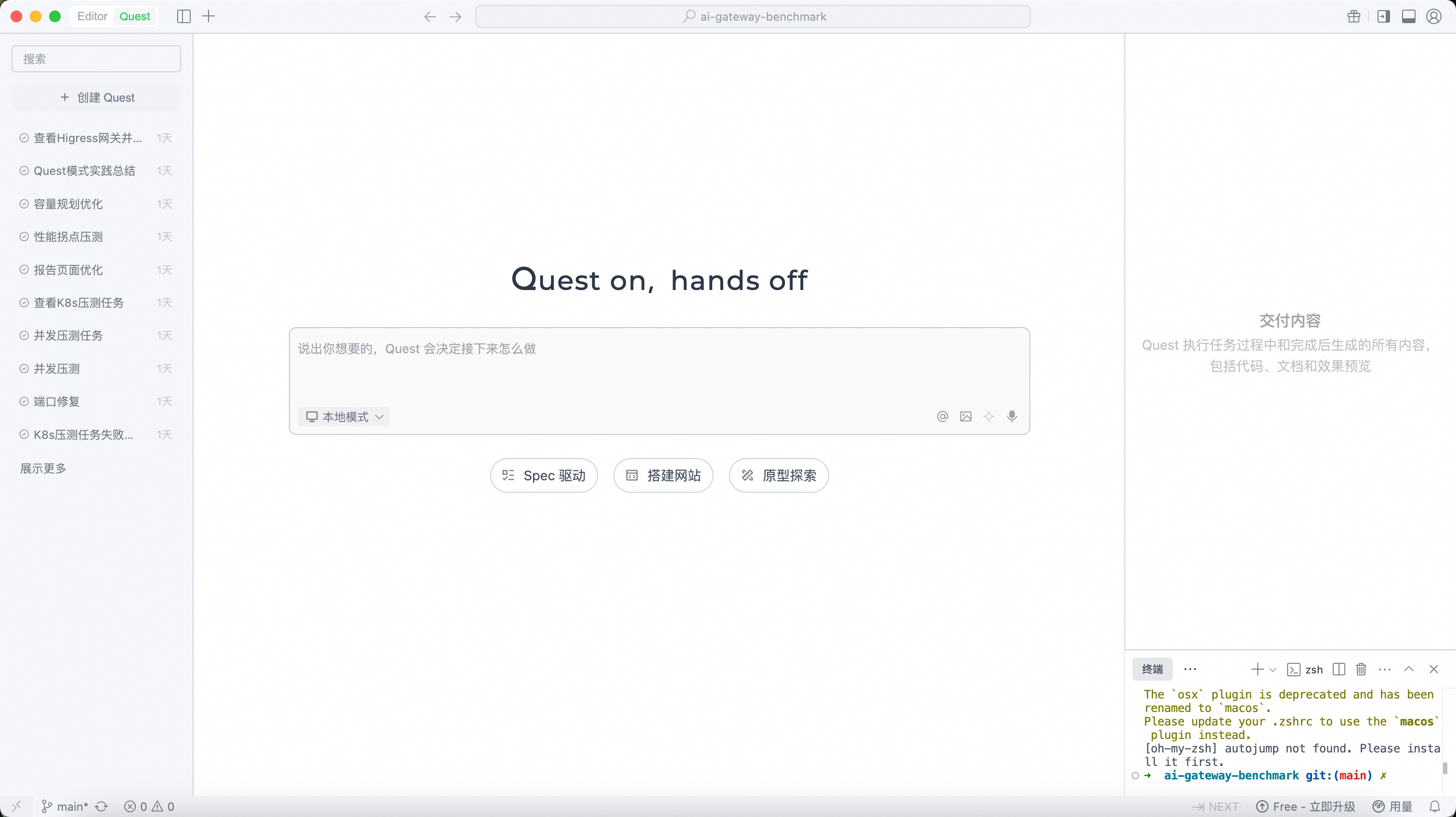

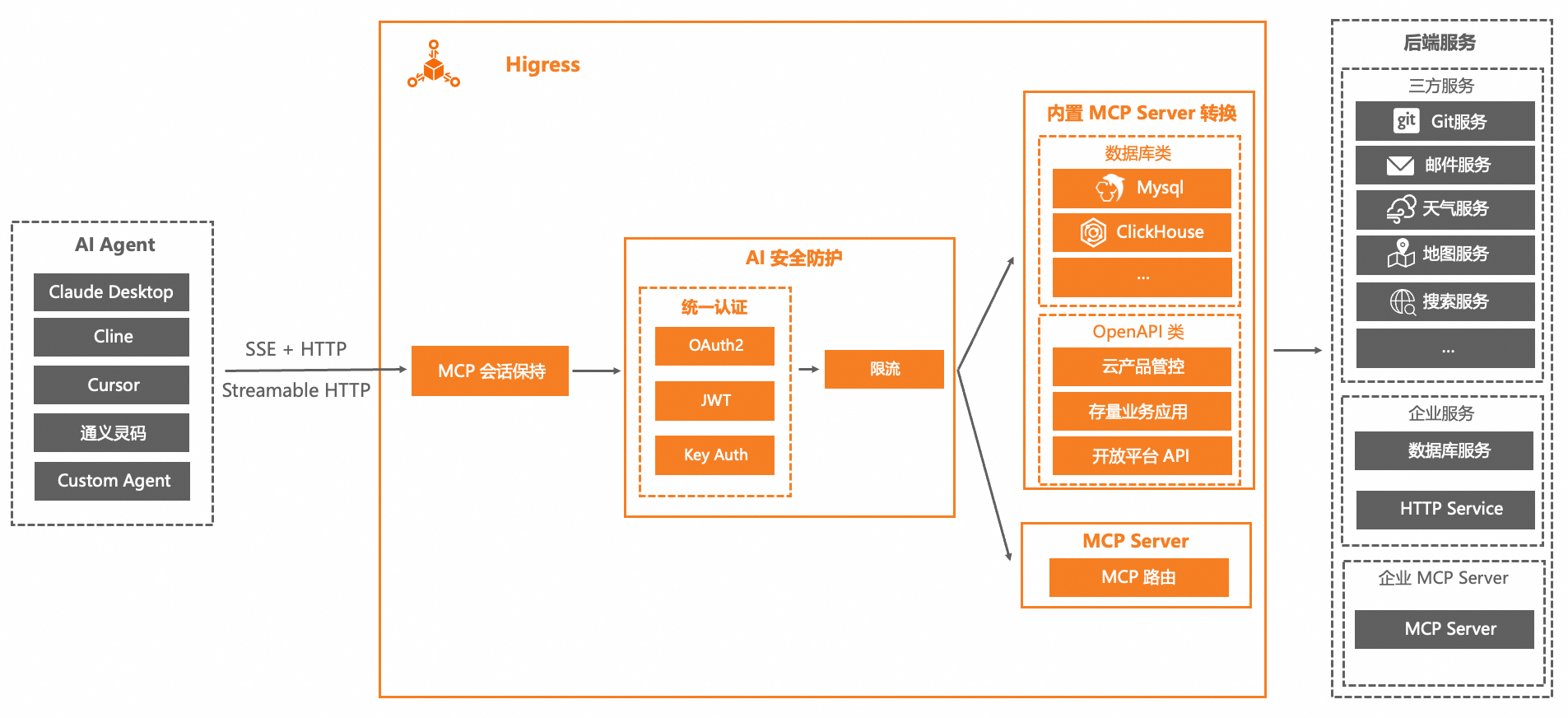

第三,是看看最先进的 AI 产品长什么样。 MCP、Skill、Plugin、Cowork、Spec Workflow、Harness Engineering 这些正在影响行业的新范式,很多都是 Anthropic、OpenAI 这类一线团队率先推出来的。订阅它们的产品,不只是为了多一个工具,而是为了第一时间摸到最新的产品边界。

第四,是看清 AI 当下的能力上限。 AI 时代选工具不是挑一把瑞士军刀,而是要在关键场景里用最强的那一档:写复杂代码看 Claude,做图片和多模态创作用 ChatGPT,做深度调研可以用 Deep Research,长任务自治可以看 Kiro。只有亲手体验过每家最强的部分,你才会真正知道当下 AI 能做到什么程度,否则很容易被零散评测或单个观点带偏。

所以下面这篇不是严格意义上的工具横评,而是我自己花钱、花时间订阅和使用之后的体感总结。按推荐顺序聊一下。

Claude —— 如果只能订一个,闭眼选它